고정 헤더 영역

상세 컨텐츠

본문

- 정보 이론

- 어떤 신호가 있다면, 신호 안에 정보가 얼마나 있는지 정량화하고자 하는 시도에서 출발한 학문

- 통신 분야에서 최초로 발명

- noisy한 채널에 메시지를 보낼 때, 메시지의 평균적인 길이가 얼마인지, 메시지 내 알파벳의 분포는 어떻게 되는지 정량화된 분석을 할 수 있음.

- 머신러닝

- 확률분포를 characterize하는데 사용이 됨 → 확률분포를 특징지어 더 잘 이해할 수 있게 도와줌

- 여러 확률 분포가 있다면, 그 확률분포들 사이에 similarity를 정량화하는데 사용됨. → ML에서는 서로 다른 두 데이터 패턴이 얼마나 비슷한지 알아야 할 때가 많음. 정보이론을 사용하면 두 확률분포가 얼마나 가까운지, 혹은 다른지 숫자로 정량화할 수 있음.

- Basic intuition

- 굉장히 일어날 것 같지 않을 일은 일어날 것이 뻔한 일보다 정보량이 더 큼. → 확률이 낮은 event가 more informative함.

- 확실한 이벤트 → 정보량이 없다.

- 확률이 높은 이벤트 → 정보량이 적다.

- 확률이 낮은 이벤트 → 정보량이 많다.

- 독립적인 이벤트 → 정보량을 서로 더할 수 있다.

- Self-information

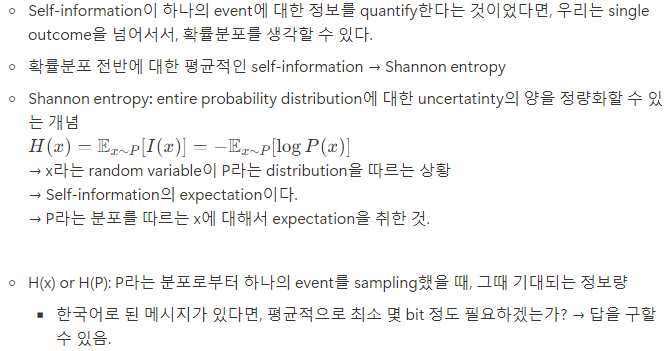

- Shannon entropy

- Kullback-Leibler (KL) divergence (relative entropy)

- Properties of KL divergence

- Cross-entropy

- 비교

'AI > Machine Learning' 카테고리의 다른 글

| PCA (0) | 2024.10.12 |

|---|---|

| sigmoid function의 이해 (0) | 2024.02.04 |